-

chevron_right

chevron_right

2FAGuard – Un super client 2FA pour Windows 10 / 11

news.movim.eu / Korben · 5 days ago - 07:00 · 1 minute

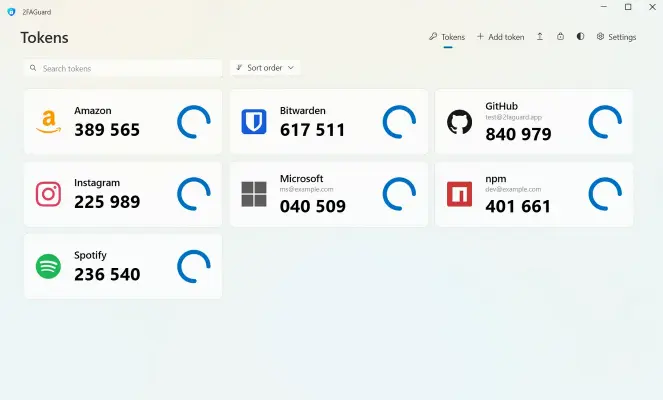

2FAGuard est une application moderne , gratuite et open source qui va vous permettre de centraliser et bien gérer vos codes de double authentification pour ensuite y accéder en un clin d’œil.

Comme ça, vous importez vos tokens 2FA existants depuis d’autres applis (Google Authenticator, Bitwarden et Authenticator Pro) en deux temps trois mouvements et c’est immédiatement utilisable. Vous pouvez même ajouter de nouveaux codes simplement en scannant le QR Code qu’un site vous donner. Et si vous êtes du genre parano (et vous avez bien raison), vous pouvez aussi exporter vos données quand vous voulez pour les mettre à l’abri ailleurs.

Côté sécurité, les gars derrière 2FAGuard n’ont pas fait les choses à moitié puisque les données sont chiffrées en AEGIS-256 et restent bien au chaud sur votre appareil. Et cerise sur le gâteau, l’appli est compatible avec Windows Hello comme ça vous pouvez vous authentifiez avec votre empreinte digitale, votre visage ou une clé de sécurité..

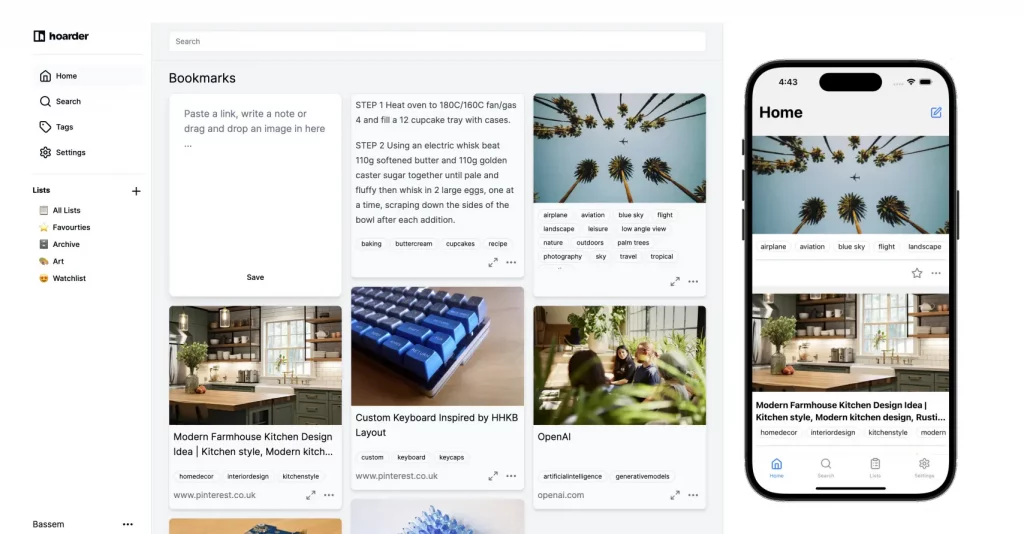

Comme vous le voyez, l’interface de 2FAGuard est plutôt minimaliste, mais c’est voulu. On a accès rapidement à tout ce dont on a besoin : la liste de nos tokens, un bouton pour en ajouter de nouveaux, un autre pour les paramètres, et c’est tout. Simple et efficace. Sachez également que vous pouvez choisir de verrouiller l’appli au démarrage ou après une certaine période d’inactivité. Vous pouvez même activer un mode « incognito » qui masque les codes à l’écran. Pratique si vous utilisez votre PC dans des lieux publics.

Côté téléchargement, vous avez le choix entre deux versions : une app Windows 10 / 11 du Microsoft Store qui se met à jour automatiquement en arrière-plan, et une version classique « desktop » qui a l’avantage d’être portable, pratique pour l’utiliser depuis une clé USB.

ps : Et si vous n’utilisez pas de code 2FA pour vos comptes en ligne, vous feriez mieux de vous y mettre.